Um novo estudo feito por pesquisadores da Universidade da Califórnia, nos Estados Unidos, conseguiu, por meio de Inteligência Artificial (IA), restaurar a fala em duas línguas diferentes de um paciente que ficou quase mudo após o mesmo ter sofrido um derrame. O feito, considerado algo inédito na área da neurociência, foi divulgado em um artigo publicado no periódico Nature Biomedical Engineering nesta terça-feira (20).

Uma equipe, formada por neurocirurgiões e especialistas em IA, implantou uma interface cérebro-computador (BCI) no crânio de um homem, apelidado de “Pancho”, e usou técnicas de IA nos dados recebidos dos impulsos nervosos para auxiliar o paciente a recuperar a capacidade de falar – em duas línguas.

Pancho sofreu um derrame aos 20 anos de idade e perdeu quase toda a habilidade de fala e parte de suas funções cognitivas. A condição, também conhecida como Acidente Vascular Cerebral (AVC), acontece quando o fornecimento de sangue para o cérebro é interrompido, por conta de algum rompimento ou entupimento dos vasos sanguíneos.

Esse cessamento causa danos profundos na massa encefálica, podendo ocasionar em graves sequelas, como a perda da fala, por exemplo.

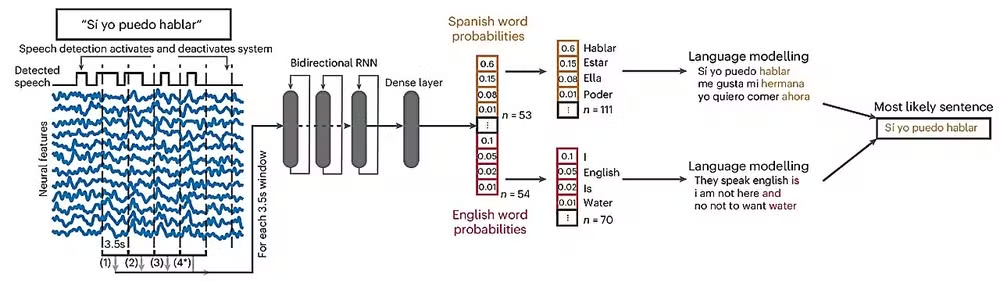

Após vários anos, com a ajuda de neurologistas, o paciente conseguiu reaprender a ler e converter palavras em seus pensamentos para o inglês – sendo que sua língua materna é o espanhol. Essa desenvoltura permitiu que ele participasse de um projeto de pesquisa que colocou uma matriz de eletrodos na superfície de uma região específica do seu cérebro, encarregada do processamento da linguagem. Um conector então foi ligado ao equipamento, o que possibilitou a conexão da BCI a um sistema de computador.

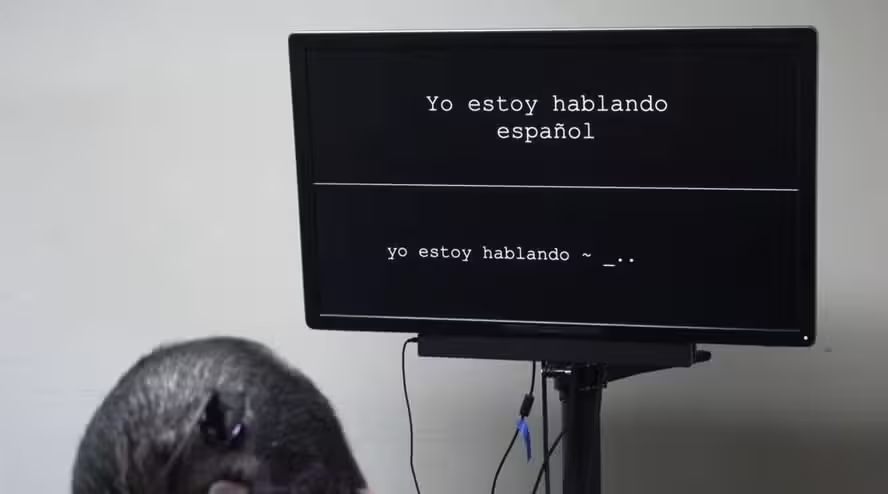

Foi necessário um treinamento por três anos para que Pancho conseguisse “programar” seu cérebro de uma maneira que pudesse ter sua fala transmitida pelo aparelho. Eram mostradas palavras na tela do computador e ele era instruído a repeti-las mentalmente. Enquanto fazia isso, os eletrodos captavam suas ondas cerebrais e tentavam convertê-las na palavra que ele estava lendo.

Como os testes eram feitos em espanhol e inglês, Pancho acabou reproduzindo vocabulários nessas duas línguas. Um modelo de linguagem de aprendizado profundo (LLM) ajudou na interpretação e conversão, reduzindo assim o número de erros.

De acordo com o portal Medical Xpress, o sistema reconheceu quando Pancho estava falando espanhol ou inglês com uma precisão de 88%. Além disso, decodificou palavras de modo geral com uma taxa de 75% de sucesso. Os pesquisadores observaram que isso foi suficiente para permitir que ele se comunicasse com a equipe de pesquisa.

Fonte: Revista Galileu